(English version below)

Ésta es la última entrada dedicada explícitamente a la Conferencia de Busán, luego de haber pensado sobre las campañas e iniciativas previas a la conferencia, los interrogantes iniciales para el mundo de la evaluación, la experiencia in-situ de dos estimadas evaluadoras, y la detallada reflexión y desafíos que nos compartiera Daniel Svoboda. Ha sido posible seguir el desarrollo de la conferencia al instante mediante Twitter (aportes que continúan al día de hoy) y varios blogs (algunos de los más interesantes para mí fueron éste, éste y éste más).

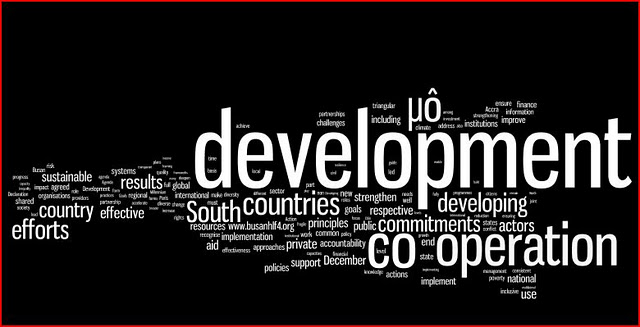

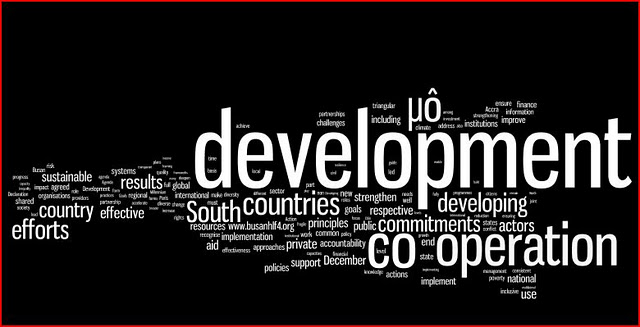

Una de las ideas más desafiantes que he leído en distintos sitios tiene que ver con lo valioso de entender a Busán no como el punto final de un proceso, sino más bien como el inicio de uno. Esta es una visión clave para ir más allá del papel y de declaraciones. Un ejercicio interesante de lo que las palabras dicen fue hecha en el blog Aidnograhpy, incorporando la declaración final de Busán en Wordle, y alcanzando el siguiente resultado:

–

–

Vemos que el vocablo Ayuda (Aid) ha dejado su lugar a Desarrollo (Development), y el lugar de la cooperación Sur-Sur también ha ganado preponderancia. El post repite el ejercicio luego con cada una de las secciones de la declaración de Busán, favoreciendo a la vez una visión más matizada. De todos modos, para marcar ciertos énfasis y acentos, la mirada general es interesante también. Más interesante aún resulta la reflexión en el mismo post sobre las palabras plásticas, a tono con el escéptico mensaje que me dejó un colega en Twitter:

Lo que en buen castizo sería: Gracias por las actualizaciones sobre Busán! La efectividad de la ayuda es un chiste… La declaración de París? Olvídala

Visiones alternativas son ofrecidas en los últimos aportes que para este blog hicieron llegar las dos evaluadoras antes invitadas. Gloria Vela, presente en la Conferencia, sumaba lo siguiente:

En términos generales hay satisfacción de las OSC porque se ha venido posicionando el términos COOPERACIÓN en lugar de ayuda aún entre los gobiernos, se mantiene el reconocimiento de las OSC como pares y se acogen los principios de Estambul y el marco de referencia de las OSC y se recoge la importancia de los derechos de las mujeres, pero también hay algunas preocupaciones, entre ellas, para mi personalmente, es preocupante que al reconocer el rol del sector privado, y las empresas en particular, en la cooperación y el desarrollo, se está hablando de la necesidad de generar para ellas un “ambiente habilitante” y la consideración de ese ambiente habilitante o propicio para las OSC queda bastante perdido!

También regresando de Busán, y pensando en el mundo de la evaluación, Oumoul Ba Tall hizo llegar su opinión:

Deseo asegurarles muy rápidamente que la evaluación estuvo muy presente en Busán, y estará en todas partes después de Busán. Para nuestra audiencia de evaluadores, me gustaría decir sólo porque la evaluación no esté en la redacción significa que no está allí. La evaluación no sólo estuvo presente en la fase anterior a la Conferencia, sino que preveo que ella será predominante después de Busán en tres niveles:

En primer término y para la fase anterior, es interesante observar las lecciones aprendidas de la evaluación de la Declaración de París. Los evaluadores deberían cuestionarse cuál fue realmente el propósito de la evaluación si las deficiencias de los compromisos anteriores no son en realidad asumidos por el siguiente paso, que es la Declaración Final de Busán. Tal como la sociedad civil con razón reclamaba acerca de los «asuntos pendientes» con la Declaración de París y la Agenda de Acción de Accra.

Después de Busán, preveo a la Evaluación siendo predominante en tres niveles:

1. El Documento Final de Busan (DBO) (o con el nombre oficial que sea elegido para reemplazar a la Declaración de París (DP) y al Programa de Acción de Accra (AAA) ) presenta un cierto número de principios básicos y orientaciones estratégicas, pero no hay ningún compromiso vinculante, según tengo entendido. Compromisos vinculantes y planes operativos de acción tendrán que ser decididos a nivel nacional, algo así como un «pacto» que se diseñó sobre la base de acuerdos entre los socios de desarrollo que participan en el ámbito nacional. Por lo tanto, los planes de seguimiento y evaluación tendrán que ser establecidos a nivel nacional, y un marco global tendría que ser establecido con el fin de evaluar la DBO también. Esta dualidad conlleva algunos desafío metodológico a la hora de evaluar la DBO en comparación con la DP, que los evaluadores podrían reflexionar en ello a partir de ahora.

2. A nivel de país, si la decisión de utilizar los sistemas nacionales se aplica como insiste en hacerlo la DBO, esto debe incluir sistemas de evaluación que son casi inexistentes en la mayoría de los países receptores. Estos sistemas tienen que ser construidos (incluyendo no sólo las instituciones, sino también la capacidad de los evaluadores nacionales) y veo ahí un papel importante para la comunidad de Evaluación.

3. La referencia a la «responsabilidad mutua» también implica la evaluación de muchas maneras. La que a mí me gustaría destacar es la nueva idea de la rendición de cuentas a los ciudadanos de los países receptores, no sólo a nivel de «Gobierno a Gobierno» , lo que también demanda un amplio programa de sensibilización por la Evaluación y la cultura de la Evaluación. Los ciudadanos deben ser capaces de utilizar la evaluación para pedir rendición de cuenta a sus gobiernos, lo que significa contar con las herramientas y métodos apropiados, así como el entorno adecuado.

Escenarios para imaginar, construir y trabajar…

^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

ENGLISH VERSION!

One of the challenging ideas that I read in several places had to do with understanding the value of Busan not as the end point of a process, but rather as the beginning of one. This is a key insight to go beyond paper and declarations. An interesting exercise in what the words say was made in the blog Aidnograhpy, incorporating the final declaration of Busan in Wordle, and reaching the following result:

–

We see that Aid has been changed to Development , and the place of South-South cooperation has also gained prominence. The post then repeats the exercise with each of the sections of the Busan Declaration, favoring a more nuanced view. Anyway, to make certain emphases and accents, the overall look is interesting too. Even more interesting is the reflection in the same post about the plastic words, which is somehow linked with the skeptical message a colleague left me on Twitter:

Alternatives views were shared by the two evaluators previously invited to this blog.

Gloria Vela, present at the Conference, added that:

In general terms there is a sense of satisfaction by the Civil Society Organizations (CSOs), because it has been increasingly used the term cooperation instead of aid, even among governments; the recognition of CSOs as peers is mantained, and the Istanbul principles, the framework of CSOs, and the importance of women’s rights, all have been very welcomed. But there are some concerns, including for myself: it is worrying that by recognizing the role of the private sector, and companies in particular, in cooperation and development,we are talking about the need to create for them an «environment enabling «and the consideration of this enabling or conducive environment for the CSOs is quite lost!

–

Also returning from Busan, and thinking for the world of evaluation, Oumoul Ba Tall sent her opinion:

I wish to assure you very quickly that Evaluation was very present at Busan, and will be everywhere post-Busan. I will be very short as I am still exhausted after almost 30 hours of travel and just one day of sleep….and as promissed, I will send more shortly. But for now, and for our Evaluation audience, I just would like to say, that it’s not only because Evaluation is not in the wording that it is not there. Not only was Evaluation present in the previous phase, but I foresee Evaluation to be predominant after Busan at three levels:

At first, for the previous phase, it is interesting to look at the lessons learned from the Evaluation of the PD. Evaluators should question what really was the purpose of the evaluation if the shortcomings of the the previous commitments are not really adressed by the next step, which is the BOD. As the CSOs were rightly claiming, the «unfinished business» with the PD and AAA are not resolved.

Post Busan, I foresee Evaluation to be predominant at three levels:

1. The Busan Outcome Document (BOD) or whatever official name will be chosen to replace the Paris Declaration (PD) and the Accra Agenda for Action (AAA) lays out a certain number of basic principles and strategic orientations, but there is no binding commitment yet as I understand. Binding commitments and operational action plans will have to be decided at the country level, something like a «compact» to be designed based on agreements between development partners involved at the country level. Therefore, Monitoring and Evaluation plans will have to be set at the national level, and a global framework would have to be set in order to assess the BOD as well. This duality brings in some methodological challenge when it comes to evaluate the BOD as compared to the PD, that Evaluators could reflect on from now.

2. At the country level, if the decision to use country systems is enforced as the BOD calls for, this should include evaluation systems which are almost inexistent in most recipient countries. Such systems will have to be built (including not only the institutions, but also the capacity of national evaluators) and I see a major role for the Evaluation community.

3. The reference to «mutual accountability» also involves evaluation in many ways. The one that I would like to highlight is the new idea of accountability to the citizens of recipient countries, not only «the Government-to-Government» level, which also calls for a wide agenda of Evaluation Awareness and Evaluation Culture. citizens need to be able to use Evaluation to held their governments accountable, which means appropriate tools and methods, and the right environment.

Scenarios to imagine, build and work…

El debate sobre cómo desarrollar capacidades tiene cierta antigüedad en la región de América Latina. Una aproximación sobre los enfoques, pasos y las competencias para desarrollar específicamente sistemas de Seguimiento y Evaluación fue construido por

El debate sobre cómo desarrollar capacidades tiene cierta antigüedad en la región de América Latina. Una aproximación sobre los enfoques, pasos y las competencias para desarrollar específicamente sistemas de Seguimiento y Evaluación fue construido por

Falta de una metodología rigurosa: Lamentablemente, la evaluación hubo de llevarse a cabo sin la necesaria prueba de control aleatoria de los regalosde Navidad, la que no se completó según lo previsto. Los gerentes de proyecto hicieron un mal trabajo explicando las ventajas de la participación en la prueba aleatoria al grupo control.

Falta de una metodología rigurosa: Lamentablemente, la evaluación hubo de llevarse a cabo sin la necesaria prueba de control aleatoria de los regalosde Navidad, la que no se completó según lo previsto. Los gerentes de proyecto hicieron un mal trabajo explicando las ventajas de la participación en la prueba aleatoria al grupo control.